曦云C系列GPU Day 0 适配智谱全新一代大模型GLM-5

智谱AI正式上线并开源全新一代大模型 GLM-5,沐曦股份实现Day 0 深度适配。 GLM-5目前可于曦云 C 系列(C500/C550/C588)上稳定高效运行。

近期,智谱AI相继发布GLM-4.6V系列多模态大模型及GLM-OCR,沐曦股份均在第一时间完成全面适配。

此次高效适配依托于沐曦股份全栈自研的MXMACA软件栈——该栈原生兼容PyTorch、TensorFlow等主流AI框架,支持模型“零代码”或极低改造成本迁移。MXMACA已于2025年2月正式开源,目前用户规模已突破25万人。

曦云C系列GPU基于沐曦股份自主核心GPU IP打造,兼具高能效比与高通用性,可高效支撑千亿参数级大模型的训练与推理任务。通过深度协同MXMACA软件栈,硬件算力得以充分释放,实现“软硬一体”的极致性能优化。

此次适配再次印证了国产AI“算力+算法”协同发展的可行性与先进性。未来,沐曦股份将持续深耕全栈技术研发,强化软硬协同与生态共建,为国产算力高质量发展提供强劲动能。

关于GLM-5

在 Coding与 Agent 能力上,GLM-5 取得开源 SOTA 表现,在真实编程场景的使用体感逼近 Claude Opus 4.5,擅长复杂系统工程与长程 Agent 任务。

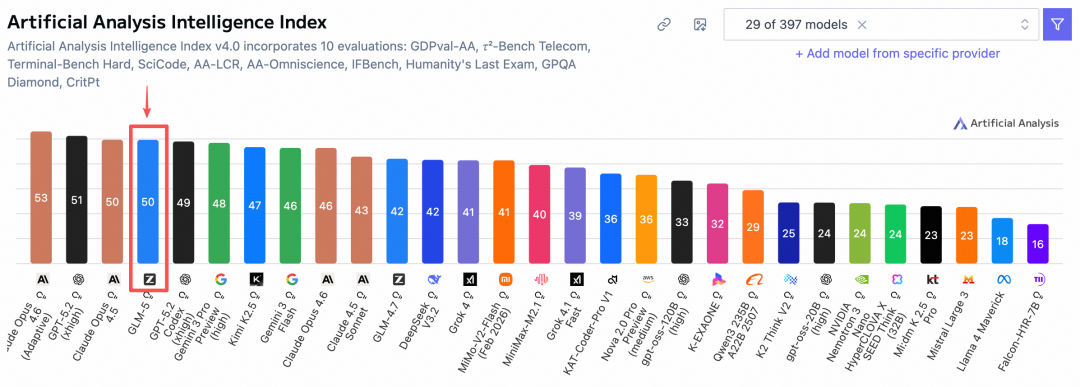

在全球权威的 Artificial Analysis 榜单中,GLM-5 位居全球第四、开源第一。

GLM-5 全新基座为从“写代码”到“写工程”的能力演进提供了坚实基础:

参数规模扩展:从 355B(激活 32B))扩展至 744B(激活 40B),预训练数据从 23T 提升至 28.5T,更大规模的预训练算力显著提升了模型的通用智能水平

异步强化学习:构建全新的"Slime"框架,支持更大模型规模及更复杂的强化学习任务,提升强化学习后训练流程效率;提出异步智能体强化学习算法,使模型能够持续从长程交互中学习,充分激发预训练模型的潜力

稀疏注意力机制:首次集成 DeepSeek Sparse Attention,在维持长文本效果无损的同时,大幅降低模型部署成本,提升 Token Efficiency

GLM-5 在编程能力上实现了对齐 Claude Opus 4.5,在业内公认的主流基准测试中取得开源模型 SOTA。在 SWE-bench-Verified 和 Terminal Bench 2.0 中分别获得 77.8 和 56.2 的开源模型最高分数,性能超过 Gemini 3 Pro。

GLM-5开源与使用方式

即日起,GLM-5 在 Hugging Face 与 ModelScope 平台同步开源,模型权重遵循 MIT License。

GLM-5 已纳入 GLM Coding Plan Max套餐,Pro 也即将上线。开发者可一键兼容 Claude Code、OpenCode、KiloCode 等主流开发工具。接下来智谱将逐步扩大范围,尽力让更多用户体验并使用 GLM-5。

- NE4411 高可靠性半桥栅极驱动器

- 固态BDU革命:SiC MOSFET对直流接触器的全面技术清算

- 当储能“细胞”遇上VPP“神经中枢”!安科瑞重构能源价值新生态

- 重庆大学:运动即供能!研发自供能无线传感器

- 青智功率分析仪电机启动方式的测试

- CW32L012/F030灵眸X1智能小车——用MPU6050做运动检测和姿态控制

- 拆解风扇灯带你看国产32位MCU控场

- 尼得科与 Technohorizon作开发用于背钻检测的自动 X 射线检测设备

- D型导电布衬垫:紧凑空间中的高效EMI屏蔽解决方案

- 指针电流表和变频器上的读数不一致的原因及解决方法

- 施耐德 M340 PLC 以太网模块与上位机、国产触摸屏核电站监控配置案例

- 中微爱芯推出高性能低压差线性稳压器AiP76XXA

- Sony FCB-ER8530 4K机芯高速差分信号线束设计要点

- 中东局势再度紧张,全球供应链承压:企业该如何应对?

- 香橙派亮相华为合作伙伴大会,赋能开发者与智慧教育新生态

- KiCad 10.0.0 正式发布