【机器视觉】睿擎平台支持NCNN AI 推理框架,轻松实现实时目标检测( 睿擎线下 Workshop 报名已开启)|产品动

在工业4.0与边缘计算加速发展的背景下,嵌入式设备的实时目标检测能力已成为智能制造等领域的核心技术需求。然而,移动端设备受限于算力与能耗,传统深度学习框架难以兼顾效率与精度。为此,睿擎平台在RT-Thread 系统上深度集成NCNN推理框架,通过其轻量化架构与硬件级优化能力,结合YOLO系列算法的高效单阶段检测特性,实现了工业场景下的目标检测系统。

一. NCNN 简介

NCNN是由腾讯公司开源的一个专为移动端平台设计的高性能神经网络前向计算框架。该框架以其轻量级、高效率以及强大的跨平台兼容性而著称,能够在资源受限的移动设备上实现深度学习模型的快速部署与高效推理。NCNN的核心优势在于其精简的库体积、优化的计算性能,特别适用于嵌入式设备等边缘计算场景中的AI应用开发。

二. YOLO 模型简介

YOLO(You Only Look Once)是一种革命性的实时目标检测架构,其核心思想是将目标检测任务重构为单阶段回归问题。与传统的两阶段检测器(如Faster R-CNN)相比,YOLO通过单次前向传播即可同时预测图像中所有目标的边界框坐标、类别概率和置信度。当前YOLO系列(v5/v7/v8/v10)持续优化精度-速度平衡,结合NCNN等轻量级推理框架,已成为工业机器视觉领域实时目标检测的部署标准。其单阶段处理架构从根本上解决了传统方法在实时性上的瓶颈,为嵌入式设备赋予高响应能力。

三. 睿擎派实战部署

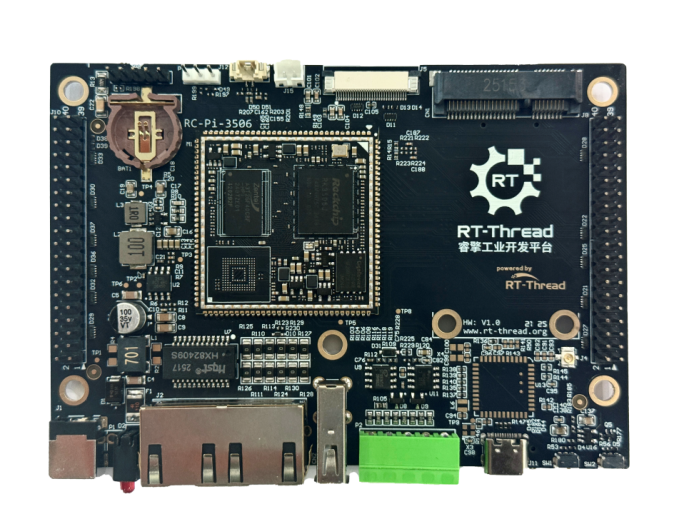

以下步骤完整展示了在睿擎派(基于瑞芯微 RK3506J 三核 Cortex A7 1.5G 主频,256M Bytes DDR,256M Bytes Nandflsh)硬件平台上部署和运行 YOLOV3 模型的过程。

1. 创建示例工程

a.示例工程

在RuiChing Studio 中,按以下步骤创建 09_ai_mobilenetv2_yolov3

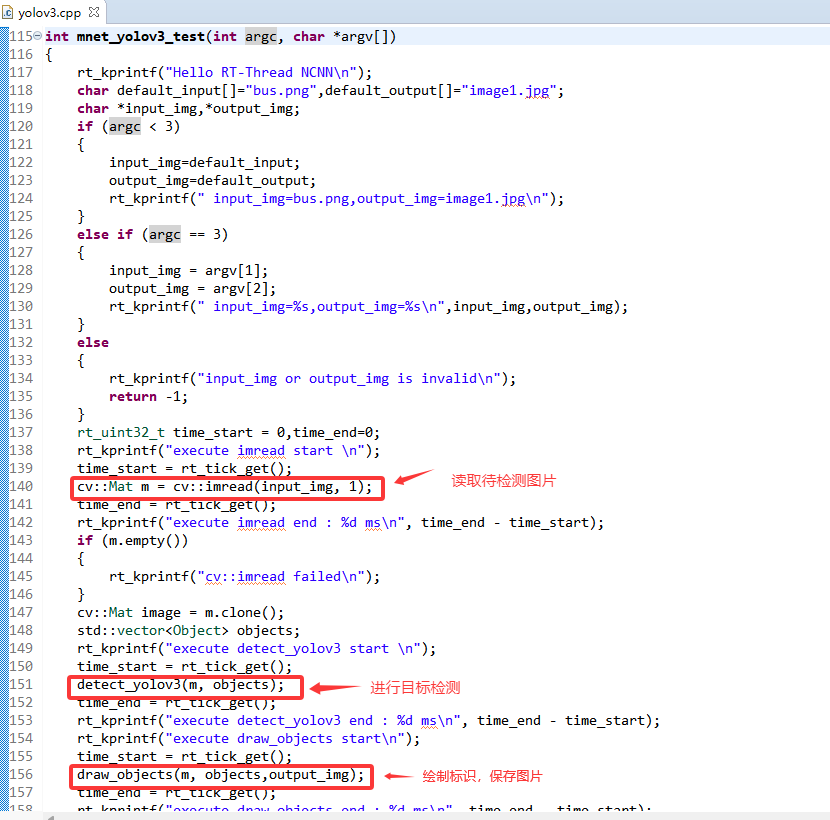

b. 核心示例代码

工程生成的 yolov3.cpp 文件中,核心代码部分如下:

c. 对核心代码解析如下:

l cv::imread:加载需要检测的图像;

l detect_yolov3:运用 YOLOv3 模型对输入的图像进行目标检测,把检测到的目标信息存于 objects 向量中;

l draw_objects :在输入图像上绘制检测到的目标框和标签,然后把绘制后的图像保存到指定路径源。

2. 编译示例工程

对 09_ai_yolo_detection 示例工程进行编译:

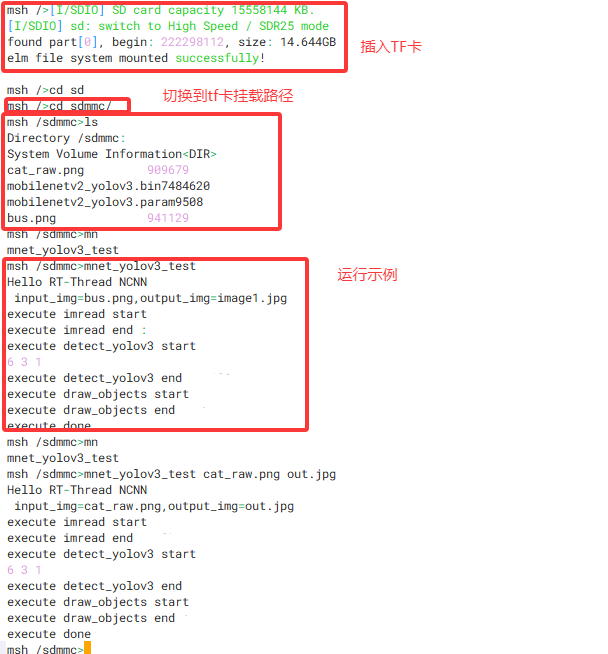

3. 运行程序

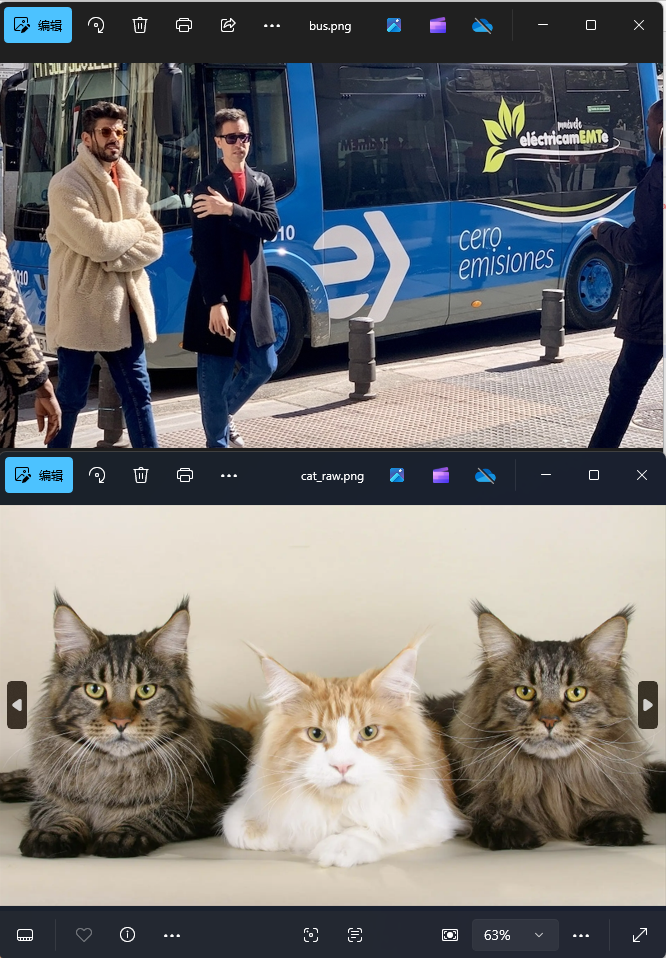

a. 准备模型和资源

在SD卡中存放mobilenetv2_yolov3.param和mobilenetv2_yolov3.bin,以及待检测的图片。

b. 运行程序

运行程序后,将测试图像传入系统,程序会调用 YOLO 模型进行目标检测,在输出图像上绘制检测到目标的边界框和类别标签。

查看检测结果

小结

睿擎工业开发平台凭借其全栈自主可控的软硬件协同架构,在成功部署YOLO等视觉检测模型的基础上,进一步支持多类型AI框架与模型的灵活接入,为工业场景提供了开放、高效的AI赋能平台。

想亲手在睿擎派上复现 NCNN+YOLO 的实时目标检测?想体验从模型部署到工业场景落地的全流程实操?

9 月 4 日,睿擎工业开发平台上海站 Workshop 为你开放专属实战机会 —— 现场不仅能近距离观摩机器视觉 DEMO(基于 NCNN 框架的实时目标检测,搭配 4.3 寸 MIPI 屏直观展示检测结果)

参会即得 “睿擎派” 50 元优惠券,更有机会抽中睿擎派开发板或《RT-Thread 设计与实现》书籍,带设备回家继续深耕机器视觉开发!

- 贝特电子IMS智能制造工厂项目顺利验收,灯塔工厂之路正式启航!

- 面向柔性制造的工业协作复合机器人应用思路

- 交流变频调速与直流调速的区别

- 2026汽车软件发展现状报告(Perforce公司出品,第六章)

- SMA接头老化了只能报废?分享几个你不知道的维护回春术

- 防逆流电能表:户用光储一体化场景的能源管理核心

- 法拉电容做电池可以用多久使用?

- 飞腾E2000Q主板,助力国产化工控产业落地

- 告别人工巡检,数据中心无线温湿度监测一步到位实现智能化

- ip6829支持苹果15w无线充吗?

- MicroComputer深度评测忆联AM6D1 DRAMLess PCIe 5.0 SSD

- 高精度贴片电阻为什么已成为刚需电子元器件?

- 界面材料BLT测试与思考

- 中微爱芯H桥直流双向马达驱动芯片AiP6208C全新上市

- 喜报 | 长江连接器有限公司CJTCONN品牌荣获"深圳知名品牌"认证(转载官网长江连接器)

- 使用吉时利3706A系统开关/万用表数据采集器监测电池单体温度